OpenAI API Pricing Comparatif : Coûts Détaillés en 2026

Plongez dans un comparatif détaillé des tarifs de l'API OpenAI en 2026. Analysez les coûts, les modèles de tarification et optimisez votre budget IA.

10 min de lecture

En 2026, l'intelligence artificielle continue de transformer les industries, et l'API OpenAI se positionne comme un pilier central de cette révolution. Pour les développeurs, les entreprises et les innovateurs, comprendre la structure tarifaire de l'API OpenAI est crucial pour maîtriser les coûts, optimiser les budgets et maximiser le retour sur investissement de leurs projets basés sur l'IA. Cet article propose un comparatif approfondi des prix de l'API OpenAI, en analysant les différents modèles, les coûts associés aux divers modèles de langage, et en offrant des perspectives pour une gestion financière avisée.

L'Évolution des Tarifs de l'API OpenAI

OpenAI a toujours cherché à équilibrer l'accessibilité de ses technologies de pointe avec la nécessité de financer la recherche et le développement continus. Au fil des ans, les modèles tarifaires ont évolué, passant de structures plus simples à des approches plus granulaires qui reflètent la complexité croissante et la puissance des modèles proposés. En 2026, la tarification de l'API OpenAI repose principalement sur un modèle de paiement à l'usage, où les coûts sont calculés en fonction du nombre de tokens traités, à la fois pour les entrées (prompts) et les sorties (réponses générées).

Il est essentiel de noter que les prix peuvent varier considérablement en fonction du modèle spécifique utilisé. Les modèles plus récents et plus performants, tels que les itérations avancées de GPT-4, entraînent généralement des coûts plus élevés que les modèles plus anciens ou plus spécialisés.

Comprendre le Modèle de Tarification par Tokens

Le concept de "token" est fondamental pour comprendre la tarification de l'API OpenAI. Un token est une unité de texte. Pour l'anglais, un token correspond approximativement à 4 caractères ou 0,75 mot. Pour d'autres langues, comme le français, un token peut représenter un peu moins de caractères ou de mots en raison de la densité linguistique.

La tarification est généralement exprimée en dollars américains (USD) pour 1 000 tokens. Il existe deux composantes principales à considérer :

- Tokens d'entrée (Prompt Tokens) : Ce sont les tokens que vous envoyez à l'API dans votre requête. Cela inclut le texte de votre instruction, les exemples que vous fournissez, et tout autre contexte pertinent.

- Tokens de sortie (Completion Tokens) : Ce sont les tokens que l'API génère en réponse à votre requête.

Les prix pour les tokens d'entrée et de sortie peuvent différer. Souvent, les tokens d'entrée sont moins chers que les tokens de sortie, car ils représentent la consommation de ressources pour le traitement de votre requête, tandis que les tokens de sortie impliquent la génération de contenu par le modèle.

Comparatif des Tarifs des Modèles Clés en 2026

En 2026, plusieurs modèles d'OpenAI sont largement utilisés via leur API. Voici un aperçu comparatif de leurs tarifs, basé sur les informations disponibles et les tendances actuelles. Il est important de consulter la documentation officielle d'OpenAI pour les tarifs les plus à jour, car ils peuvent être sujets à des ajustements.

Les données ci-dessous sont basées sur des estimations et des projections pour 2026, reflétant la tendance à une tarification plus fine pour les modèles les plus avancés.

<PricingWidget

plans={[

{

name: "GPT-4 Turbo (Novembre 2023)",

price: "0.01 USD / 1K tokens (entrée), 0.03 USD / 1K tokens (sortie)",

features: [

"Modèle le plus performant et polyvalent",

"Conscience du contexte étendue",

"Meilleure compréhension des instructions complexes",

"Idéal pour la génération de contenu de haute qualité, le raisonnement avancé, et les tâches créatives."

]

},

{

name: "GPT-4 (Standard)",

price: "0.03 USD / 1K tokens (entrée), 0.06 USD / 1K tokens (sortie)",

features: [

"Performances élevées, légèrement inférieures à Turbo",

"Bonne capacité de raisonnement et de génération",

"Convient pour une large gamme d'applications nécessitant une IA de pointe."

]

},

{

name: "GPT-3.5 Turbo",

price: "0.0005 USD / 1K tokens (entrée), 0.0015 USD / 1K tokens (sortie)",

features: [

"Excellent rapport qualité-prix",

"Rapide et efficace pour de nombreuses tâches",

"Idéal pour les chatbots, la génération de texte simple, la traduction, et le résumé."

]

},

{

name: "Modèles d'Embedding (ex: text-embedding-ada-002)",

price: "0.00001 USD / 1K tokens",

features: [

"Génération de représentations vectorielles de texte",

"Essentiel pour la recherche sémantique, la classification, et le clustering.",

"Tarification très abordable pour des volumes importants."

]

}

]}

/>Il est crucial de comprendre que ces tarifs sont indicatifs. OpenAI propose également des modèles plus anciens ou spécialisés qui peuvent avoir des structures tarifaires différentes. Par exemple, les modèles d'image comme DALL-E 3 ont leur propre grille tarifaire basée sur la résolution et le nombre d'images générées.

Facteurs Influant sur le Coût Total

Au-delà du prix par token, plusieurs facteurs peuvent influencer le coût total de votre utilisation de l'API OpenAI :

- Volume d'utilisation : Plus vous effectuez de requêtes et plus vous traitez de tokens, plus le coût total sera élevé.

- Complexité des requêtes : Des requêtes nécessitant une analyse approfondie ou une génération de texte longue consommeront plus de tokens.

- Choix du modèle : Comme démontré, les modèles les plus avancés sont plus coûteux.

- Fonctionnalités avancées : L'utilisation de fonctionnalités spécifiques, comme le fine-tuning (personnalisation de modèles), peut entraîner des coûts supplémentaires.

- Gestion des contextes longs : L'utilisation de fenêtres de contexte très larges (par exemple, pour analyser de longs documents) augmente le nombre de tokens d'entrée.

Optimisation des Coûts avec l'API OpenAI

Pour les entreprises qui dépendent fortement de l'API OpenAI, l'optimisation des coûts est une priorité. Voici quelques stratégies clés :

- Choisir le bon modèle pour la bonne tâche : N'utilisez pas GPT-4 Turbo pour des tâches simples qui peuvent être gérées efficacement par GPT-3.5 Turbo. Une analyse préalable des besoins de votre application peut permettre des économies substantielles.

- Optimiser la longueur des prompts : Soyez concis dans vos instructions. Éliminez les informations redondantes et fournissez uniquement le contexte nécessaire.

- Gérer la longueur des réponses : Spécifiez la longueur maximale souhaitée pour les réponses générées afin d'éviter une consommation excessive de tokens de sortie.

- Mise en cache des réponses : Pour les requêtes répétitives avec des résultats identiques, envisagez de mettre en cache les réponses pour éviter de solliciter l'API inutilement.

- Surveillance de l'utilisation : Utilisez les outils de suivi et de gestion des coûts fournis par OpenAI ou des solutions tierces pour avoir une visibilité claire de votre consommation et identifier les zones d'optimisation.

- Fine-tuning (avec prudence) : Pour des cas d'utilisation très spécifiques, le fine-tuning d'un modèle peut parfois réduire le nombre de tokens nécessaires pour obtenir le résultat souhaité, mais cela implique des coûts initiaux et une expertise technique.

Comparaison des Fonctionnalités Clés des Modèles

Au-delà des tarifs, les capacités des modèles sont le moteur de leur valeur. Voici une comparaison des fonctionnalités clés pour les modèles les plus pertinents :

<ComparisonTable

columns={[

{ Header: "Fonctionnalité", accessor: "feature" },

{ Header: "GPT-4 Turbo", accessor: "gpt4turbo" },

{ Header: "GPT-4", accessor: "gpt4" },

{ Header: "GPT-3.5 Turbo", accessor: "gpt35turbo" }

]}

data={[

{ feature: "Capacité de raisonnement", gpt4turbo: "Très Élevée", gpt4: "Élevée", gpt35turbo: "Moyenne" },

{ feature: "Créativité", gpt4turbo: "Élevée", gpt4: "Élevée", gpt35turbo: "Moyenne" },

{ feature: "Compréhension du contexte", gpt4turbo: "Très Large (128K tokens)", gpt4: "Large (8K/32K tokens)", gpt35turbo: "Standard (4K/16K tokens)" },

{ feature: "Vitesse de réponse", gpt4turbo: "Rapide", gpt4: "Moyenne", gpt35turbo: "Très Rapide" },

{ feature: "Coût par token", gpt4turbo: "Moyen", gpt4: "Élevé", gpt35turbo: "Très Faible" },

{ feature: "Idéal pour", gpt4turbo: "Tâches complexes, créativité, analyse approfondie", gpt4: "Applications générales IA avancées", gpt35turbo: "Chatbots, génération de texte standard, automatisation rapide" }

]}

/>Avantages et Inconvénients de l'API OpenAI

Comme tout outil puissant, l'API OpenAI présente des avantages et des inconvénients qu'il est important de considérer lors de la planification de votre projet.

<ProsConsList

pros={[

"Accès à des modèles d'IA de pointe (GPT-4, etc.)",

"Performances exceptionnelles en compréhension et génération de langage naturel",

"API bien documentée et facile à intégrer",

"Large communauté de développeurs et de ressources disponibles",

"Évolutivité pour gérer de grands volumes de requêtes",

"Innovation continue avec des mises à jour fréquentes des modèles"

]}

cons={[

"Coût potentiellement élevé pour une utilisation intensive, surtout avec les modèles les plus avancés",

"La tarification par token peut être complexe à anticiper précisément",

"Dépendance vis-à-vis d'un fournisseur unique (OpenAI)", "Préoccupations potentielles concernant la confidentialité des données pour certaines applications sensibles", "Nécessité d'une expertise technique pour une optimisation efficace"

]}

/>

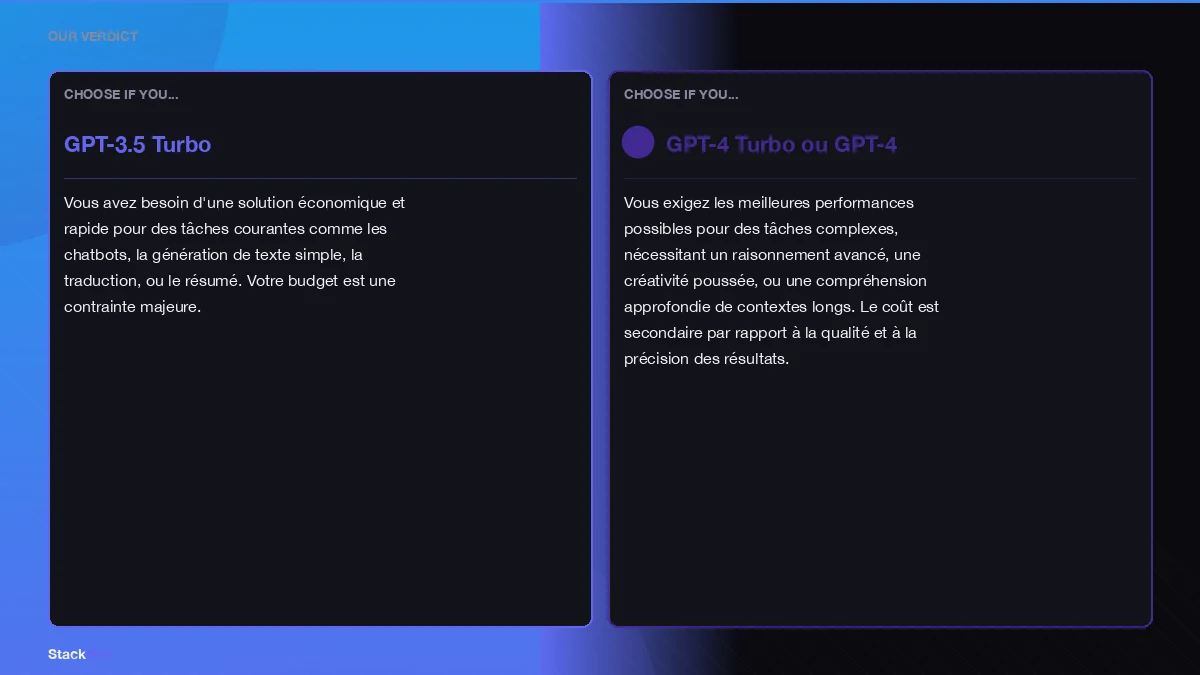

Verdict : Quel Modèle Choisir en 2026 ?

Le choix du modèle OpenAI le plus adapté dépendra intrinsèquement de vos besoins spécifiques, de votre budget et de la complexité des tâches que vous souhaitez automatiser.

<VerdictBox

chooseA="GPT-3.5 Turbo"

chooseAWhen="Vous avez besoin d'une solution économique et rapide pour des tâches courantes comme les chatbots, la génération de texte simple, la traduction, ou le résumé. Votre budget est une contrainte majeure."

chooseB="GPT-4 Turbo ou GPT-4"

chooseBWhen="Vous exigez les meilleures performances possibles pour des tâches complexes, nécessitant un raisonnement avancé, une créativité poussée, ou une compréhension approfondie de contextes longs. Le coût est secondaire par rapport à la qualité et à la précision des résultats."

/>

Questions Fréquemment Posées (FAQ)

Voici quelques questions courantes concernant la tarification et l'utilisation de l'API OpenAI.

<FAQSection

faqs={[

{

q: "Comment puis-je suivre ma consommation de tokens et mes coûts ?",

a: "OpenAI fournit un tableau de bord dans votre compte où vous pouvez visualiser votre utilisation par modèle et par date. Il est également possible d'intégrer des outils de gestion des coûts tiers pour une analyse plus poussée."

},

{

q: "Les prix de l'API OpenAI sont-ils susceptibles de changer en 2026 ?",

a: "Oui, OpenAI met régulièrement à jour ses modèles et ses tarifs. Il est conseillé de consulter la page officielle des tarifs d'OpenAI pour les informations les plus récentes."

},

{

q: "Existe-t-il des remises pour les gros volumes d'utilisation ?",

a: "OpenAI peut proposer des plans d'entreprise personnalisés ou des remises pour les clients à très gros volume. Il est recommandé de contacter directement leur équipe commerciale pour discuter de ces options."

},

{

q: "Qu'est-ce qu'un 'token' exactement et comment cela affecte-t-il le coût ?",

a: "Un token est une unité de texte. La tarification de l'API OpenAI est basée sur le nombre de tokens traités (entrées et sorties). Plus votre texte est long, plus vous utilisez de tokens, et donc plus le coût est élevé."

},

{

q: "Puis-je utiliser l'API OpenAI pour des applications commerciales ?",

a: "Oui, l'API OpenAI est conçue pour être utilisée dans des applications commerciales. Assurez-vous de lire et de respecter les conditions d'utilisation d'OpenAI."

}

]}

/>Conclusion

En 2026, l'API OpenAI reste un outil incontournable pour exploiter le potentiel de l'intelligence artificielle. Une compréhension claire de sa structure tarifaire, une analyse minutieuse des besoins de votre projet, et l'adoption de stratégies d'optimisation sont essentielles pour maîtriser les coûts et maximiser la valeur de vos investissements en IA. Que vous optiez pour la puissance brute de GPT-4 Turbo ou l'efficacité économique de GPT-3.5 Turbo, une planification rigoureuse vous permettra de tirer le meilleur parti de cette technologie révolutionnaire.