Frameworks RAG : Le Guide Comparatif Ultime pour 2026

Comparez les meilleurs frameworks RAG : LangChain, LlamaIndex, Dify, RAGFlow et plus. Découvrez leurs fonctionnalités, prix et avantages pour votre projet IA.

19 min de lecture

Le paysage de l'intelligence artificielle évolue à une vitesse vertigineuse, et les systèmes de génération augmentée par récupération (Retrieval-Augmented Generation - RAG) sont au cœur de cette révolution. Ces systèmes permettent aux grands modèles linguistiques (LLM) d'accéder à des informations externes et à jour, améliorant ainsi leur précision, leur pertinence et leur capacité à répondre à des requêtes spécifiques. Mais face à la multitude d'outils et de frameworks RAG disponibles, comment choisir celui qui convient le mieux à vos besoins ?

Chez StackRev, nous nous sommes plongés dans les profondeurs de cet écosystème pour vous offrir un comparatif détaillé des frameworks RAG les plus performants en 2026. Nous analyserons leurs fonctionnalités clés, leurs modèles de tarification, leurs avantages et inconvénients, afin de vous aider à prendre une décision éclairée.

Qu'est-ce qu'un Framework RAG et Pourquoi est-il Crucial ?

Avant de plonger dans les comparaisons, rappelons brièvement ce qu'est un framework RAG et pourquoi il est devenu indispensable. Un système RAG combine la puissance des LLM avec une base de connaissances externe. Le processus typique se déroule comme suit :

- Récupération (Retrieval) : Lorsqu'une requête utilisateur est soumise, le système recherche des informations pertinentes dans une base de données externe (souvent une base de données vectorielle contenant des embeddings de vos documents).

- Augmentation (Augmentation) : Les informations récupérées sont ensuite fournies au LLM comme contexte supplémentaire.

- Génération (Generation) : Le LLM utilise ce contexte enrichi pour générer une réponse plus précise, factuelle et personnalisée.

Les frameworks RAG sont les outils qui orchestrent ce processus. Ils fournissent l'infrastructure, les abstractions et les intégrations nécessaires pour construire, déployer et gérer des applications RAG complexes. Sans eux, la mise en place d'un système RAG serait une tâche ardue, nécessitant une expertise approfondie en développement logiciel et en IA.

Les Acteurs Majeurs du Marché RAG en 2026

Le marché des frameworks RAG est dynamique, avec des acteurs établis et de nouvelles solutions émergentes. Nous avons sélectionné les plus influents et les plus prometteurs pour ce comparatif :

- LangChain : Le vétéran incontesté, connu pour sa flexibilité et son vaste écosystème.

- LlamaIndex : Axé sur l'ingestion et l'indexation de données, il excelle dans la connexion de sources de données personnalisées.

- Dify : Une solution axée sur le développement visuel, idéale pour les utilisateurs moins techniques.

- RAGFlow : Spécialisé dans le traitement avancé des documents, y compris les tableaux, images et graphiques.

- RAGatouille : Un framework open-source puissant axé sur la recherche avancée et le fine-tuning.

- Meilisearch : Bien qu'étant principalement un moteur de recherche, il offre des capacités RAG intéressantes, notamment pour la recherche multilingue.

- Pinecone : Une base de données vectorielle managée, souvent utilisée en conjonction avec des frameworks RAG.

- Weaviate : Une autre base de données vectorielle open-source populaire, avec des options managées.

- Qdrant : Une base de données vectorielle performante, offrant des solutions cloud et auto-hébergées.

- MongoDB Atlas : Une plateforme de base de données cloud polyvalente qui intègre des fonctionnalités vectorielles.

LangChain : Le Couteau Suisse du RAG

LangChain continue de dominer le paysage RAG grâce à son approche modulaire et à son immense communauté. Il permet de construire des chaînes complexes d'appels à des LLM, des outils et des sources de données.

Fonctionnalités Clés de LangChain

- Chaînage de Composants : La force principale de LangChain réside dans sa capacité à orchestrer des séquences d'actions, des chargements de documents à la génération de réponses finales.

- Flexibilité des Données et des Modèles : Il s'intègre avec une multitude de sources de données (PDF, CSV, sites web, Notion) et prend en charge divers fournisseurs de LLM (OpenAI, Anthropic, Azure).

- Intégrations Vastes : Supporte de nombreuses bases de données vectorielles comme Pinecone, Weaviate, Milvus, et des outils d'observabilité comme LangSmith et LangGraph.

- Chargement de Documents : Offre des connecteurs robustes pour une large gamme de formats de documents.

Tarification de LangChain

LangChain lui-même est open-source et gratuit. Cependant, les coûts réels proviennent de l'utilisation des LLM sous-jacents et des bases de données vectorielles. LangChain propose des niveaux de tarification pour ses services managés et ses outils d'observabilité :

Avantages et Inconvénients de LangChain

LlamaIndex : L'Expert de l'Indexation de Données

LlamaIndex se distingue par son focus sur la connexion et l'indexation de vos données privées pour les LLM. Il excelle dans la création d'index de données personnalisés et dans la récupération d'informations précises.

Fonctionnalités Clés de LlamaIndex

- Connecteurs de Données Flexibles : Permet de se connecter facilement à diverses sources de données, y compris des API personnalisées et des bases de données internes.

- Indexation Personnalisable : Offre un contrôle granulaire sur la manière dont vos données sont indexées, optimisant ainsi la récupération.

- Architecture Modulaire : Facilite l'intégration de différents composants, y compris avec LangChain.

- Compatibilité Étendue : Fonctionne avec de nombreuses bases de données vectorielles et LLM.

Tarification de LlamaIndex

LlamaIndex propose une structure de tarification échelonnée pour ses services managés :

Avantages et Inconvénients de LlamaIndex

Dify : Le RAG Visuel pour Tous

Dify se positionne comme une plateforme de développement IA axée sur la simplicité et l'accessibilité, particulièrement grâce à son éditeur de flux de travail visuel.

Fonctionnalités Clés de Dify

- Éditeur de Flux de Travail Visuel : Permet de construire des applications RAG sans écrire de code complexe, idéal pour les utilisateurs non techniques.

- Support Étendu des Modèles : Intégration avec une large gamme de LLM.

- Capacités d'Agents : Inclut des fonctionnalités pour créer des agents IA autonomes.

- Gestion de Base de Connaissances Visuelle : Interface intuitive pour gérer vos données.

- API REST Incluse : Facilite l'intégration dans des applications existantes.

Tarification de Dify

Dify propose une tarification progressive pour ses services :

Avantages et Inconvénients de Dify

RAGFlow : Le Maître du Traitement Documentaire Avancé

RAGFlow se distingue par sa capacité à gérer des documents complexes, en allant au-delà du simple texte pour extraire des informations de tableaux, d'images et de graphiques.

Fonctionnalités Clés de RAGFlow

- Analyse Avancée de Documents : Capacité à parser des tableaux, des images et des graphiques pour en extraire des informations structurées.

- Compréhension Profonde des Documents : Va au-delà de la simple recherche par mots-clés.

- Support GraphRAG : Permet de construire des graphes de connaissances pour une meilleure compréhension contextuelle.

- Interface Visuelle : Facilite la configuration et la gestion des flux RAG.

- Options de Stockage Flexibles : Compatible avec Elasticsearch, Infinity, et d'autres backends.

Tarification de RAGFlow

RAGFlow propose une tarification basée sur l'utilisation des ressources de calcul :

Avantages et Inconvénients de RAGFlow

RAGatouille : La Puissance Open-Source pour la Recherche Avancée

RAGatouille est un framework open-source qui met l'accent sur des techniques de récupération avancées, offrant une précision accrue grâce à son approche de "late-interaction".

Fonctionnalités Clés de RAGatouille

- Récupération "Late-Interaction" : Une approche innovante pour une meilleure pertinence des résultats.

- Capacités de Fine-Tuning : Permet d'affiner le modèle pour des tâches spécifiques et des domaines de connaissance.

- Correspondance au Niveau du Token : Offre une granularité fine dans la recherche.

- Intégration LangChain : Fonctionne comme un récupérateur et un réordonnanceur dans les chaînes LangChain.

- Flux de Compression Contextuelle : Optimise la quantité de contexte passé au LLM.

Tarification de RAGatouille

Étant entièrement open-source, RAGatouille est gratuit. Les coûts sont liés à l'infrastructure nécessaire pour l'exécuter.

Avantages et Inconvénients de RAGatouille

Meilisearch : Le Moteur de Recherche Polyglotte pour le RAG

Meilisearch, bien que principalement un moteur de recherche, offre des fonctionnalités qui peuvent être exploitées pour des applications RAG, notamment grâce à son excellent support multilingue.

Fonctionnalités Clés de Meilisearch

- Tokenisation Multilingue : Supporte plus de 20 langues, y compris le chinois, le japonais et le thaïlandais.

- Recherche Plein Texte : Capacités de recherche robustes pour des résultats pertinents.

- Option d'Auto-hébergement : Flexibilité pour déployer sur votre propre infrastructure.

Tarification de Meilisearch

Meilisearch propose des plans basés sur l'utilisation et le volume de données :

Avantages et Inconvénients de Meilisearch

Les Bases de Données Vectorielles : Le Cœur du RAG

Les frameworks RAG s'appuient souvent sur des bases de données vectorielles pour stocker et interroger efficacement les embeddings de vos données. Voici quelques acteurs clés :

Pinecone : La Base de Données Vectorielle Managée par Excellence

Pinecone est une base de données vectorielle entièrement managée, conçue pour la performance et la scalabilité des applications IA.

Fonctionnalités Clés de Pinecone

- Intégration Transparente : S'intègre facilement avec LangChain et LlamaIndex.

- Compatibilité avec les Embeddings : Supporte les embeddings d'OpenAI, Cohere, Hugging Face, etc.

- Métriques de Distance et Paramètres de Recherche : Offre un contrôle fin sur les requêtes vectorielles.

- Filtrage de Résultats : Permet de raffiner les résultats de recherche.

Tarification de Pinecone

Pinecone propose une tarification basée sur le stockage et l'utilisation :

Avantages et Inconvénients de Pinecone

Weaviate : La Base de Données Vectorielle Open-Source et Managée

Weaviate est une base de données vectorielle open-source qui offre également des options cloud managées pour simplifier le déploiement.

Tarification de Weaviate

Qdrant : Performance et Flexibilité

Qdrant est une base de données vectorielle performante, offrant des options cloud et auto-hébergées.

Tarification de Qdrant

MongoDB Atlas : La Polyvalence au Service du RAG

MongoDB Atlas, la plateforme cloud de MongoDB, intègre désormais des capacités de recherche vectorielle, offrant une solution unifiée pour vos données.

Tarification de MongoDB Atlas

Comparaison Détaillée des Frameworks RAG

Pour vous aider à visualiser les différences, voici un tableau comparatif des fonctionnalités clés des principaux frameworks RAG :

Tendances Récentes et Évolutions

L'écosystème des frameworks RAG continue de mûrir. On observe une focalisation accrue sur les interfaces de développement visuelles (Dify, RAGFlow) et des capacités de traitement documentaire plus avancées. Les frameworks open-source comme LangChain, LlamaIndex et RAGFlow dominent grâce à une forte adoption communautaire. Les fournisseurs de bases de données vectorielles (Pinecone, Weaviate, Qdrant) introduisent des modèles de tarification plus flexibles et des options serverless pour réduire les coûts d'infrastructure. L'intégration d'AWS S3 Vectors avec Bedrock Knowledge Bases promet des économies significatives pour le stockage de vecteurs à grande échelle, marquant un tournant vers des solutions managées et optimisées en coût.

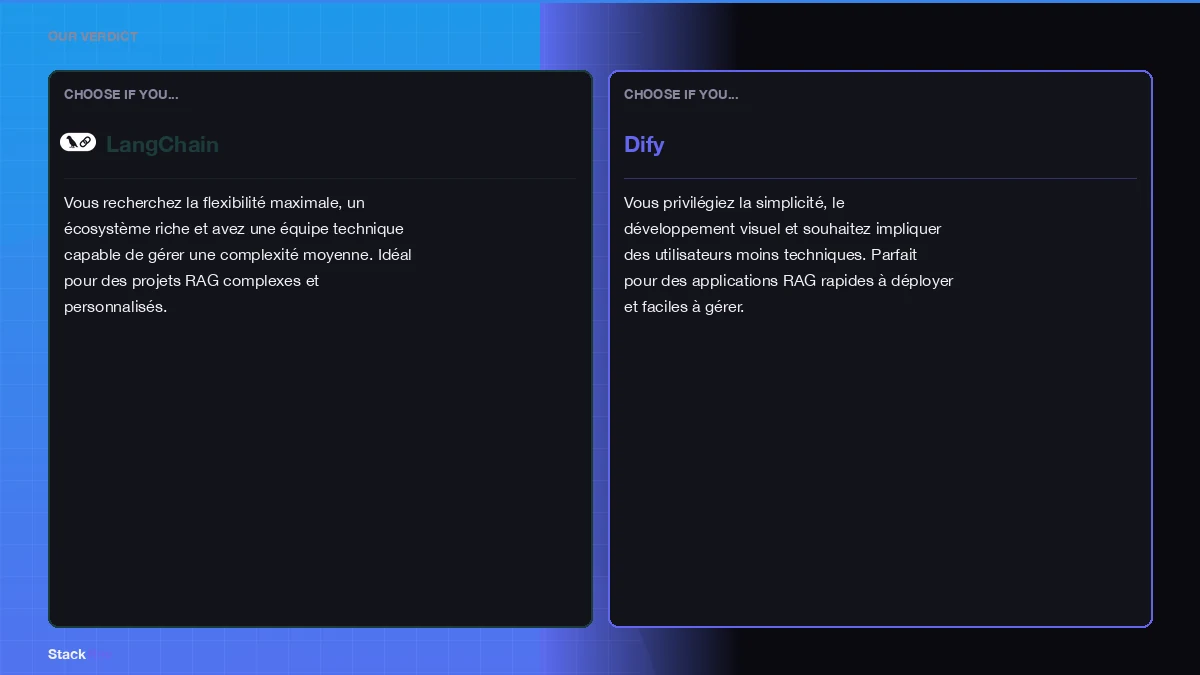

Verdict : Quel Framework RAG Choisir ?

Le choix du framework RAG idéal dépendra de vos besoins spécifiques, de votre expertise technique et de votre budget.

Pour les utilisateurs qui recherchent une solution axée sur l'ingestion et l'indexation de données personnalisées, LlamaIndex est un excellent choix. Si le traitement avancé de documents complexes est votre priorité, RAGFlow est à considérer. Pour une approche purement open-source et axée sur la recherche de pointe, RAGatouille est imbattable. Enfin, pour des besoins de recherche multilingue performante, Meilisearch peut être une option intéressante.

N'oubliez pas que les bases de données vectorielles comme Pinecone, Weaviate, Qdrant ou MongoDB Atlas sont des composants essentiels de la plupart des architectures RAG et doivent être choisies en fonction de vos exigences en matière de performance, de scalabilité et de coût.

Questions Fréquemment Posées (FAQ)

Frequently Asked Questions

Sources

- Meilisearch Blog - RAG Tools

- Metacto - Understanding the True Cost of RAG Implementation

- Netsolutions - RAG Operational Cost Guide

- Clore.ai - RAG Frameworks Comparison

- Firecrawl.dev - Best Open Source RAG Frameworks

- YouTube - RAG Frameworks Explained

- TheDataGuy.pro - Economics of RAG Cost Optimization

- AIMultiple - Retrieval Augmented Generation

- Galileo.ai - RAG vs Traditional LLMs